Компания OpenAI представила новую версию языковой модели с генеративным искусственным интеллектом GPT-4o. Новая, более продвинутая версия модели способна работать с речью, текстом и видео. На это и отсылает буква «o» в названии — сокращение от «omni» (лат. «всесторонний»), сообщает TechCrunch со ссылкой на сайт компании.

GPT-4o реагирует на аудиозапросы в среднем за 320 миллисекунд, что сопоставимо со временем реакции человека в разговоре.

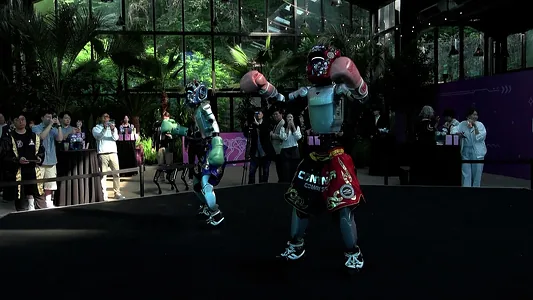

«GPT-4o может работать с голосом, текстом и зрением. И это невероятно важно, потому что мы смотрим на будущее взаимодействия между нами и машинами», — заявила технический директор OpenAI Мира Мурати во время презентации в офисе OpenAI в Сан-Франциско 13 мая.

По производительности новая модель соответствует GPT-4 Turbo, но при этом «особенно хорошо справляется с изображением и пониманием звука», подчеркивают в OpenAI.

GPT-4o свободно владеет 50 языками и доступна для пользователей с 13 мая. Пока что голосовые функции модели будут доступны лишь «небольшой группе доверенных партнеров», но уже в июне ими смогут воспользоваться платные подписчики.