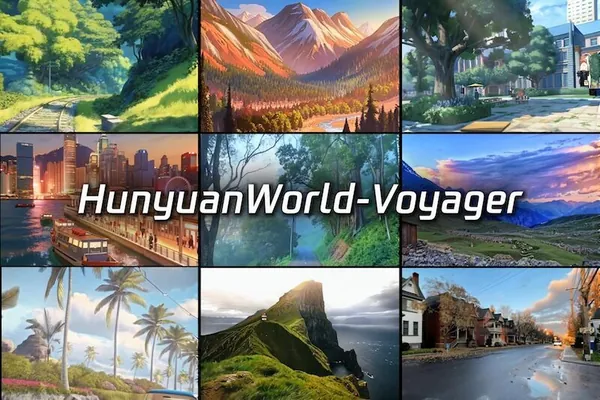

Китайская компания Tencent представила открытую ИИ-модель HunyuanWorld-Voyager, которая позволяет генерировать видеоряд с 3D-эффектом на основе одного исходного изображения.

Алгоритм формирует до 49 кадров, что составляет около двух секунд видео, и объединяет их в последовательности длительностью несколько минут. При этом создаётся эффект движения камеры в реальном 3D-пространстве: объекты сохраняют свои позиции, а перспектива изменяется корректно.

HunyuanWorld-Voyager одновременно генерирует цветное видео и карты глубины (RGB-D), что позволяет использовать данные для реконструкции трёхмерных облаков точек. В основе работы лежит сопоставление шаблонов с геометрическими ограничениями: каждый кадр преобразуется в точечную 3D-модель, которая затем проецируется обратно в 2D для согласования с новыми изображениями. Такой подход обеспечивает более высокую пространственную согласованность по сравнению с другими ИИ-генераторами видео.

По данным Tencent, обучение модели проводилось на базе более 100 тыс. видеоклипов, в том числе созданных на движке Unreal Engine. По сути, ИИ-алгоритм обучили имитировать движение 3D-камер в среде видеоигр.

Система требует значительных вычислительных ресурсов: не менее 60 ГБ видеопамяти для генерации сцен в разрешении 540p и 80 ГБ — для более высокого качества.

Исходный код HunyuanWorld-Voyager и документация размещены на платформе Hugging Face. Использование алгоритма сопровождается лицензионными ограничениями: модель запрещено применять в странах ЕС, Великобритании и Южной Корее, а коммерческое использование с аудиторией свыше 100 млн пользователей требует отдельного лицензирования.