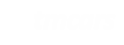

Недолгая история немого ИИ-видео подошла к концу. На конференции I/O 2025 Google представила модель Veo 3 — первую версию генеративного ИИ, которая создаёт видео по тексту вместе со звуком.

В отличие от других решений, модель не требует дополнительных указаний для создания звуков: она анализирует содержимое кадров и автоматически подбирает звуковое сопровождение.

Veo 3 синхронизирует изображение с аудиодорожкой, добавляя звуковые эффекты, фоновые шумы и даже диалоги. Пользователи могут описывать персонажей, обстановку и то, как должны звучать реплики, сообщил руководитель Google DeepMind Демис Хассабис.

Компания не раскрывает, на каких данных обучали Veo 3. Однако, по информации TechCrunch, в разработке могли использоваться материалы с YouTube. Ранее Google уже заявляла, что контент платформы «может» применяться для тренировки ИИ-моделей.

В отличие от аналогов от OpenAI, Runway, Alibaba и других разработчиков, Veo 3 поддерживает полноценное звуковое сопровождение. В основе технологии — система video-to-audio, ранее разработанная в DeepMind. Она анализирует видео на уровне пикселей и подбирает подходящий звук.

Все ролики, созданные с помощью Veo 3, автоматически помечаются встроенным невидимым водяным знаком SynthID — для защиты от дипфейков и дезинформации.

Тем временем многие художники и аниматоры выражают обеспокоенность. По данным исследования, заказанного Гильдией аниматоров США, к 2026 году ИИ может вытеснить около 100 тысяч рабочих мест в киноиндустрии, на телевидении и в анимации.

Veo 3 уже доступна в приложении Gemini для подписчиков тарифа AI Ultra стоимостью $249 в месяц.